更多

- 话题1/3

8k 热度

3k 热度

9k 热度

6k 热度

3k 热度

- 置顶

- 🎉Gate 2025 上半年社区盛典:内容达人评选投票火热进行中 🎉

🏆 谁将成为前十位 #Gate广场# 内容达人?

投票现已开启,选出你的心头好

🎁赢取 iPhone 16 Pro Max、限量周边等好礼!

📅投票截止:8 月 15 日 10:00(UTC+8)

立即投票: https://www.gate.com/activities/community-vote

活动详情: https://www.gate.com/announcements/article/45974

- 📢 #Gate广场征文活动第二期# 正式启动!

分享你对 $ERA 项目的独特观点,推广ERA上线活动, 700 $ERA 等你来赢!

💰 奖励:

一等奖(1名): 100枚 $ERA

二等奖(5名): 每人 60 枚 $ERA

三等奖(10名): 每人 30 枚 $ERA

👉 参与方式:

1.在 Gate广场发布你对 ERA 项目的独到见解贴文

2.在贴文中添加标签: #Gate广场征文活动第二期# ,贴文字数不低于300字

3.将你的文章或观点同步到X,加上标签:Gate Square 和 ERA

4.征文内容涵盖但不限于以下创作方向:

ERA 项目亮点:作为区块链基础设施公司,ERA 拥有哪些核心优势?

ERA 代币经济模型:如何保障代币的长期价值及生态可持续发展?

参与并推广 Gate x Caldera (ERA) 生态周活动。点击查看活动详情:https://www.gate.com/announcements/article/46169。

欢迎围绕上述主题,或从其他独特视角提出您的见解与建议。

⚠️ 活动要求:

原创内容,至少 300 字, 重复或抄袭内容将被淘汰。

不得使用 #Gate广场征文活动第二期# 和 #ERA# 以外的任何标签。

每篇文章必须获得 至少3个互动,否则无法获得奖励

鼓励图文并茂、深度分析,观点独到。

⏰ 活动时间:2025年7月20日 17

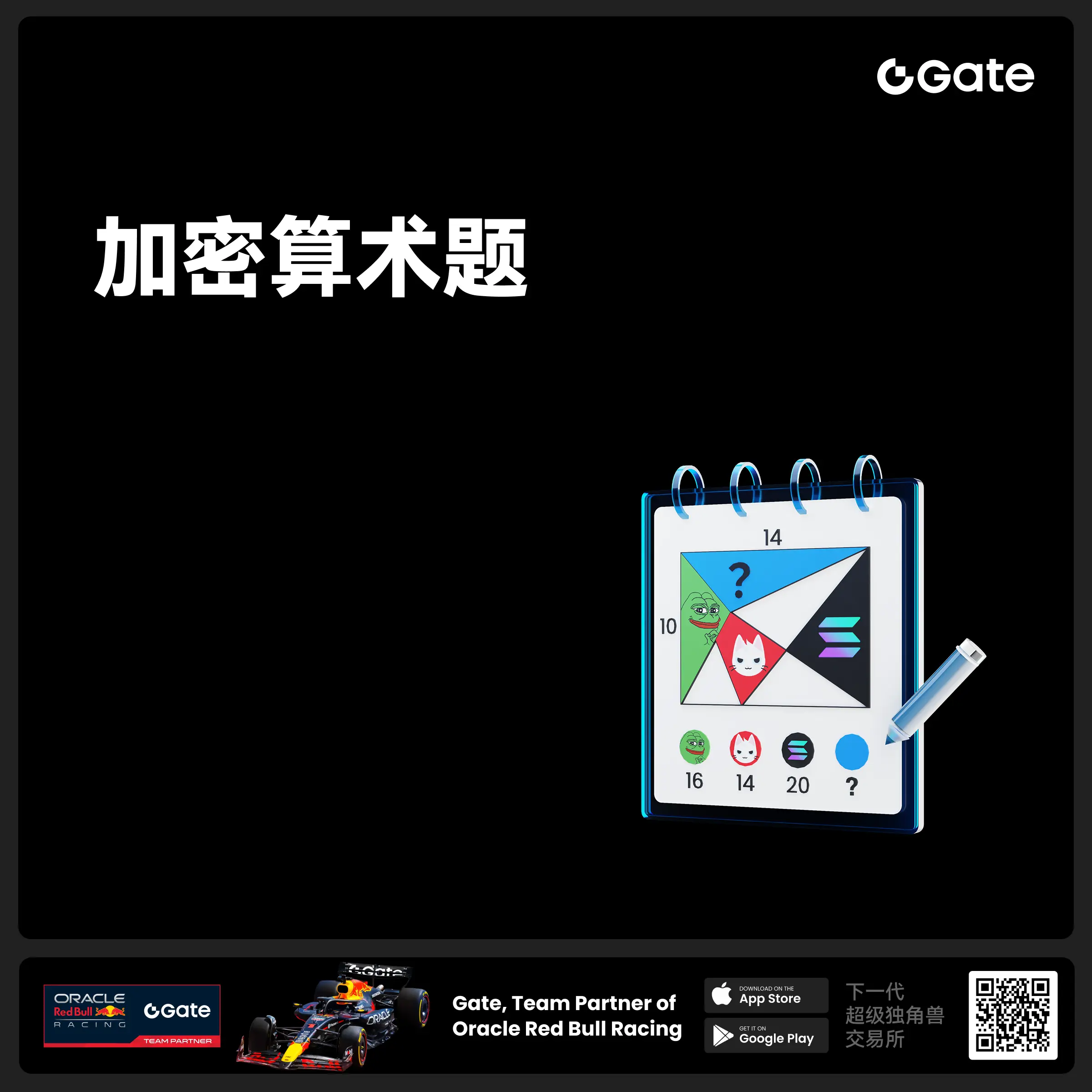

- 🧠 #GateGiveaway# - 加密算术题挑战!

你能解出这道加密题吗?

💰 $10 合约体验券 * 4 位获奖者

参与方式:

1️⃣ 关注 Gate广场_Official

2️⃣ 点赞此条动态贴文

3️⃣ 在评论中留下你的答案

📅 截止时间:7 月 22 日 12:00(UTC+8)

- 📢 ETH冲击4800?我有话说!快来“Gate广场”秀操作,0.1 ETH大奖等你拿!

牛市预言家,可能下一个就是你!想让你的观点成为广场热搜、赢下ETH大奖?现在就是机会!

💰️ 广场5位优质发帖用户+X浏览量前5发帖用户,瓜分0.1 ETH!

🎮 活动怎么玩,0门槛瓜分ETH!

1.话题不服来辩!

带 #ETH冲击4800# 和 #ETH# 在 广场 或 K线ETH下 围绕一下主题展开讨论:

-ETH是否有望突破4800?

-你看好ETH的原因是什么?

-你的ETH持仓策略是?

-ETH能否引领下一轮牛市?

2. X平台同步嗨

在X平台发帖讨论,记得带 #GateSquare# 和 #ETH冲击4800# 标签!

把你X返链接提交以下表单以瓜分大奖:https://www.gate.com/questionnaire/6896

✨发帖要求:

-内容须原创,字数不少于100字,且带活动指定标签

-配图、行情截图、分析看法加分,图文并茂更易精选

-禁止AI写手和灌水刷屏,一旦发现取消奖励资格

-观点鲜明、逻辑清晰,越有料越好!

关注ETH风向,创造观点价值,从广场发帖开始!下一个牛市“预言家”,可能就是你!🦾🏆

⏰ 活动时间:2025年7月18日 16:00 - 2025年7月28日 23:59(UTC+8)

【立即发帖】 展现你的真知灼见,赢取属于你的ETH大奖!

- 🎉 #Gate Alpha 第三届积分狂欢节 & ES Launchpool# 联合推广任务上线!

本次活动总奖池:1,250 枚 ES

任务目标:推广 Eclipse($ES)Launchpool 和 Alpha 第11期 $ES 专场

📄 详情参考:

Launchpool 公告:https://www.gate.com/zh/announcements/article/46134

Alpha 第11期公告:https://www.gate.com/zh/announcements/article/46137

🧩【任务内容】

请围绕 Launchpool 和 Alpha 第11期 活动进行内容创作,并晒出参与截图。

📸【参与方式】

1️⃣ 带上Tag #Gate Alpha 第三届积分狂欢节 & ES Launchpool# 发帖

2️⃣ 晒出以下任一截图:

Launchpool 质押截图(BTC / ETH / ES)

Alpha 交易页面截图(交易 ES)

3️⃣ 发布图文内容,可参考以下方向(≥60字):

简介 ES/Eclipse 项目亮点、代币机制等基本信息

分享你对 ES 项目的观点、前景判断、挖矿体验等

分析 Launchpool 挖矿 或 Alpha 积分玩法的策略和收益对比

🎁【奖励说明】

评选内容质量最优的 10 位 Launchpool/Gate

长文本成为大模型新标配 国内外巨头争相突破40万token

长文本能力成为大模型公司的新"标配"

大模型正以惊人的速度提升其处理长文本的能力,从4000个token扩展到40万个token。长文本处理能力似乎已成为大模型厂商的又一新"标配"。

国外方面,OpenAI通过多次升级将GPT-3.5的上下文输入长度从4千增至1.6万token,GPT-4从8千增至3.2万token。OpenAI的主要竞争对手Anthropic则一次性将上下文长度提升到10万token。LongLLaMA更是将上下文长度扩展到25.6万token甚至更多。

国内方面,大模型初创公司月之暗面推出的Kimi Chat可支持输入20万汉字,约合40万token。港中文和MIT联合开发的LongLoRA技术,可将7B模型的文本长度扩展到10万token,70B模型扩展到3.2万token。

目前,OpenAI、Anthropic、Meta、月之暗面等众多顶级大模型公司和研究机构都将拓展上下文长度作为升级重点。这些公司也都是资本市场追捧的热门对象。OpenAI获得近120亿美元投资,Anthropic估值有望达到300亿美元,月之暗面短短半年内完成近20亿元融资。

大模型厂商竞相攻克长文本技术,将上下文长度扩大100倍意味着什么?

表面上看,这意味着模型可以输入更长的文本,阅读能力更强。GPT-3.5的4000 token仅能输入约2000个汉字,而Kimi Chat的40万token可支持输入20万汉字,足以阅读一部长篇小说。

从更深层次看,长文本技术正在推动大模型在金融、司法、科研等专业领域的应用落地。在这些领域,长文档摘要、阅读理解、问答等能力是基础需求,也是亟待智能化升级的方向。

然而,类似于模型参数,文本长度并非越长越好。研究表明,模型支持更长的上下文输入并不直接等同于效果更好。关键在于模型如何有效利用上下文内容。

不过,目前国内外对文本长度的探索还未达到"临界点"。各大模型公司仍在不断突破,40万token可能只是一个开始。

为什么要"卷"长文本?

月之暗面创始人杨植麟表示,正是由于大模型输入长度受限,才造成了许多应用落地的困境。这也是各大模型公司当前聚焦长文本技术的原因所在。

例如,在虚拟角色场景中,由于长文本能力不足,虚拟角色会忘记重要信息。在开发剧本杀类游戏时,输入长度不够会导致规则和设定被削减,无法达到预期效果。在法律、银行等专业领域,深度内容分析和生成常常受挫。

长文本在未来Agent和AI原生应用中也扮演重要角色。Agent需要依靠历史信息进行规划和决策,AI原生应用需要上下文来保持连贯、个性化的用户体验。

杨植麟认为,无论是文字、语音还是视频,对海量数据的无损压缩可以实现高程度的智能。大模型的上限由单步能力和执行步骤数共同决定,其中单步能力与参数量相关,执行步骤数即上下文长度。

同时,长文本可以通过提供更多上下文和细节信息,帮助模型更准确地判断语义,减少歧义,提高推理准确性。

长文本技术既可以解决大模型早期的一些问题,增强某些功能,也是进一步推进产业应用落地的关键技术。这标志着通用大模型发展进入了从LLM到Long LLM的新阶段。

以月之暗面新发布的Kimi Chat为例,可以一窥Long LLM阶段大模型的升级功能:

这表明,对话机器人正在向专业化、个性化、深度化方向发展,这或许是撬动产业应用和超级APP落地的又一抓手。

杨植麟认为,国内大模型市场会分为toB和toC两个阵营。在toC领域,会出现基于自研模型的超级应用。

不过,目前市面上的长文本对话场景仍有很大优化空间。如不支持联网获取最新信息、生成过程无法暂停修改、仍偶尔出现胡说八道的情况等。

长文本的"不可能三角"困境

在长文本技术中,存在文本长短、注意力和算力的"不可能三角"困境:

这一困境的根源在于现有大模型主要基于Transformer结构。其中最重要的自注意力机制虽然能突破输入顺序的限制,但计算量会随上下文长度呈平方级增长。

这就构成了"不可能三角"中的第一组矛盾:文本长短与注意力。同时,处理长文本需要更多算力,与算力稀缺的现状又形成了第二组矛盾。

目前主要有三种解决方案:

借助外部工具辅助处理长文本,将长文本切分为多个短文本处理

优化自注意力机制计算,如LongLoRA技术通过分组计算降低计算量

对模型进行优化,如LongLLaMA通过微调现有模型来支持更长序列

长文本的"不可能三角"困境或许暂时无解,但这也明确了大模型厂商的探索路径:在文本长短、注意力和算力三者间寻求平衡,既能处理足够信息,又能兼顾注意力计算与算力成本。